把源改为清华的镜像

# HOMEBREW_BOTTLE_DOMAIN就是目标源 修改这个路径就可以里

echo ‘export HOMEBREW_BOTTLE_DOMAIN=https://mirrors.tuna.tsinghua.edu.cn/homebrew-bottles’>> ~/.bash_profile

source ~/.bash_profile #执行.bash_profile脚本让配置即时生效

把源改为清华的镜像

# HOMEBREW_BOTTLE_DOMAIN就是目标源 修改这个路径就可以里

echo ‘export HOMEBREW_BOTTLE_DOMAIN=https://mirrors.tuna.tsinghua.edu.cn/homebrew-bottles’>> ~/.bash_profile

source ~/.bash_profile #执行.bash_profile脚本让配置即时生效

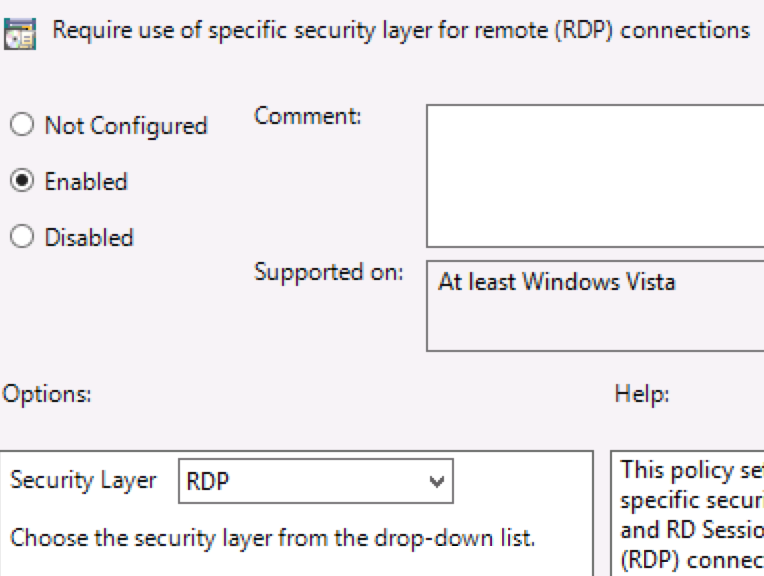

依次执行以下操作

win+R

gpedit.msc

计算机配置

管理模板

windows组件

远程桌面服务

远程桌面会话主机

安全

远程(RDP)链接要求使用制定的安全层—已启用—安全层选择RDP

1. 基础用法

1) 从网上下载单个文件

wget http://*.com/file.iso

2) 下载一个文件,但以不同的名字存为本地文件

wget --output-document=filename.html freehao123.com

3) 下载一个文件,存到指定的目录

wget --directory-prefix=folder/subfolder freehao123.com

4) 恢复之前中断的一个wget下载

wget --continue *.com/big.file.iso

wget -c freehao123.com/big.file.iso

5) 下载一个文件,但只在服务器上的版本比本地版本新时才会真正执行

wget --continue --timestamping *.com/latest.zip

6) 用wget下载多个网址,这些网址存于一个文本文件中,一行一个网址

wget --input list-of-file-urls.txt

7) 从服务器下载一些以连续序号为文件名的文件

wget http://example.com/images/{1..20}.jpg

wget http://example.com/images/pre-{1..20}-post.jpg

8) 下载一个网页,包括它所有的内容,比如样式表和包含的图片,它们是确保网页离线显示所必需的

wget -page-requisites --span-hosts --convert-links --adjust-extension http://example.com/dir/file

wget -p -H -k -E http://example.com/dir/file

2.进阶用法

1) 下载整个网站,包括它所有链接的页面和文件 wget --execute robots=off --recursive --no-parent --continue --no-clobber http://example.com/ wget -e robots=off -r -np -c -nc http://example.com/ 2) 从网站上一个子目录中下载所有MP3文件 wget --level=1 --recursive --no-parent --accept mp3,MP3 http://example.com/mp3/ wget -l 1 -r -np -A mp3,MP3 http://example.com/mp3/ 3) 将一个网站上的所有图片下载到同一个目录中 wget --directory-prefix=files/pictures --no-directories --recursive --no-clobber --accept jpg,gif,png,jpeg http://example.com/images/ wget -P files/pictures -nd -r -nc -A jpg,gif,png,jpeg http://example.com/images/ 4) 从一个网站上下载PDF文件,采用递归的方式,但不跳出指定的网域 wget --mirror --domains=abc.com,files.abc.com,docs.abc.com --accept=pdf http://abc.com/ wget -m -D abc.com,files.abc.com,docs.abc.com -A pdf http://abc.com/ 5) 从一个网站上下载所有文件,但是排除某些目录 wget --recursive --no-clobber --no-parent --exclude-directories /forums,/support http://example.com wget -r -nc -np -X /forums,/support http://example.com

3.高阶用法

1) 下载网站上的文件,假设此网站检查User Agent和HTTP参照位址(referer) wget --referer=/5.0 --user-agent="Firefox/4.0.1" http://*.com 2) 从密码保护网站上下载文件 wget --http-user=labnol --http-password=hello123 http://example.com/secret/file.zip 3) 抓取登陆界面后面的页面。你需要将用户名和密码替换成实际的表格域值,而URL应该指向(实际的)表格提交页面 wget --cookies=on --save-cookies cookies.txt --keep-session-cookies --post-data 'user=labnol&password=123' http://example.com/login.php wget --cookies=on --load-cookies cookies.txt --keep-session-cookies http://example.com/paywall 4) 在不下载的情况下,得到一个文件的大小 (在网络响应中寻找用字节表示的文件长度) wget --spider --server-response http://example.com/file.iso wget --spider -S http://example.com/file.iso 5) 下载一个文件,但不存储为本地文件,而是在屏幕上显示其内容 wget --output-document=- --quiet google.com/humans.txt wget -O- -q google.com/humans.txt 6) 得到网页的最后修改日期 (检查HTTP头中的Last Modified标签) wget --server-response --spider http://www.*.com/ wget -S --spider http://www.*.com/ 7) 检查你的网站上的链接是否都可用。spider选项将令wget不会在本地保存网页 wget --output-file=logfile.txt --recursive --spider http://example.com wget -O logfile.txt -r --spider http://example.com

PS:参数说明

* 启动

-V, --version 显示wget的版本后退出

-h, --help 打印语法帮助

-b, --background 启动后转入后台执行

-e, --execute=COMMAND 执行`.wgetrc'格式的命令,wgetrc格式参见/etc/wgetrc或~/.wgetrc

* 记录和输入文件

-o, --output-file=FILE 把记录写到FILE文件中

-a, --append-output=FILE 把记录追加到FILE文件中

-d, --debug 打印调试输出

-q, --quiet 安静模式(没有输出)

-v, --verbose 冗长模式(这是缺省设置)

-nv, --non-verbose 关掉冗长模式,但不是安静模式

-i, --input-file=FILE 下载在FILE文件中出现的URLs

-F, --force-html 把输入文件当作HTML格式文件对待

-B, --base=URL 将URL作为在-F -i参数指定的文件中出现的相对链接的前缀

--sslcertfile=FILE 可选客户端证书

--sslcertkey=KEYFILE 可选客户端证书的KEYFILE

--egd-file=FILE 指定EGD socket的文件名

* 下载

--bind-address=ADDRESS 指定本地使用地址(主机名或IP,当本地有多个IP或名字时使用)

-t, --tries=NUMBER 设定最大尝试链接次数(0 表示无限制).

-O --output-document=FILE 把文档写到FILE文件中

-nc, --no-clobber 不要覆盖存在的文件或使用.#前缀

-c, --continue 接着下载没下载完的文件

--progress=TYPE 设定进程条标记

-N, --timestamping 不要重新下载文件除非比本地文件新

-S, --server-response 打印服务器的回应

--spider 不下载任何东西

-T, --timeout=SECONDS 设定响应超时的秒数

-w, --wait=SECONDS 两次尝试之间间隔SECONDS秒

--waitretry=SECONDS 在重新链接之间等待1...SECONDS秒

--random-wait 在下载之间等待0...2*WAIT秒

-Y, --proxy=on/off 打开或关闭代理

-Q, --quota=NUMBER 设置下载的容量限制

--limit-rate=RATE 限定下载输率

* 目录

-nd --no-directories 不创建目录

-x, --force-directories 强制创建目录

-nH, --no-host-directories 不创建主机目录

-P, --directory-prefix=PREFIX 将文件保存到目录 PREFIX/...

--cut-dirs=NUMBER 忽略 NUMBER层远程目录

* HTTP 选项

--http-user=USER 设定HTTP用户名为 USER.

--http-passwd=PASS 设定http密码为 PASS.

-C, --cache=on/off 允许/不允许服务器端的数据缓存 (一般情况下允许).

-E, --html-extension 将所有text/html文档以.html扩展名保存

--ignore-length 忽略 `Content-Length'头域

--header=STRING 在headers中插入字符串 STRING

--proxy-user=USER 设定代理的用户名为 USER

--proxy-passwd=PASS 设定代理的密码为 PASS

--referer=URL 在HTTP请求中包含 `Referer: URL'头

-s, --save-headers 保存HTTP头到文件

-U, --user-agent=AGENT 设定代理的名称为 AGENT而不是 Wget/VERSION.

--no-http-keep-alive 关闭 HTTP活动链接 (永远链接).

--cookies=off 不使用 cookies.

--load-cookies=FILE 在开始会话前从文件 FILE中加载cookie

--save-cookies=FILE 在会话结束后将 cookies保存到 FILE文件中

* FTP 选项

-nr, --dont-remove-listing 不移走 `.listing'文件

-g, --glob=on/off 打开或关闭文件名的 globbing机制

--passive-ftp 使用被动传输模式 (缺省值).

--active-ftp 使用主动传输模式

--retr-symlinks 在递归的时候,将链接指向文件(而不是目录)

* 递归下载

-r, --recursive 递归下载--慎用!

-l, --level=NUMBER 最大递归深度 (inf 或 0 代表无穷).

--delete-after 在现在完毕后局部删除文件

-k, --convert-links 转换非相对链接为相对链接

-K, --backup-converted 在转换文件X之前,将之备份为 X.orig

-m, --mirror 等价于 -r -N -l inf -nr.

-p, --page-requisites 下载显示HTML文件的所有图片

* 递归下载中的包含和不包含(accept/reject)

-A, --accept=LIST 分号分隔的被接受扩展名的列表

-R, --reject=LIST 分号分隔的不被接受的扩展名的列表

-D, --domains=LIST 分号分隔的被接受域的列表

--exclude-domains=LIST 分号分隔的不被接受的域的列表

--follow-ftp 跟踪HTML文档中的FTP链接

--follow-tags=LIST 分号分隔的被跟踪的HTML标签的列表

-G, --ignore-tags=LIST 分号分隔的被忽略的HTML标签的列表

-H, --span-hosts 当递归时转到外部主机

-L, --relative 仅仅跟踪相对链接

-I, --include-directories=LIST 允许目录的列表

-X, --exclude-directories=LIST 不被包含目录的列表

-np, --no-parent 不要追溯到父目录

在将一台服务器的操作系统由Windows Server 2012升级为Windows Server 2012 R2之后,在Mac电脑上用微软的远程桌面软件怎么也连不上服务器,错误信息如下:

Remote Desktop Connection cannot verify the identity of the computer that you want to connect to. Try reconnecting to the Windows-based computer, or contact our administrator.

而在Windows电脑上可以正常用远程桌面连上。

后来在superuser网站上找到了解决方法, 需要在Windows Server 2012 R2服务器上通过组策略个性远程桌面服务的安装设置。

实际采用的解决方法如下:

注:在控制面板的Remote settings中,取消”Allow connections only from computers running Remote Desktop with Network Level Authentication”的选择,等同于上面的将Security Layer设置为RDP。

win+r

输入

rundll32.exe shell32.dll,Control_RunDLL desk.cpl,,0

剩下不用说也会了

chmod +x *.sh ./install_vnc_server.sh

遇到提示:The script is already exist,please next time to run this script.

这是由于前面执行过一次,执行失败或者其它终止脚本导致脚本未成功执行完毕。因此脚本生成的临时文件未被删除。临时文件在/tmp目录下文件名是.xxxx.sh

删除此文件,然后再重新安装即可。

yum -y install firefox yum -y install fonts-chinese

vncpasswd

vi /etc/sysconfig/vncservers

rpm -qa|grep squid yum install squid cd /etc/squid/ cp squid.conf squid.conf.bak

常用命令

service squid stop service squid srtat service squid restart

/etc/init.d/squid start/stop/restart

重新载入配置文件 service squid reload 显示中文 vi squid.conf,加入 error_directory /usr/share/squid/errors/zh-cn

最终配置文件:

http_port 6688 //设置监听的IP与端口号 cache_mem 128 MB //设置内存缓冲的大小 cache_dir ufs /var/spool/squid 4096 16 256 //设置硬盘缓冲大小 cache_effective_user squid //设置缓存的有效用户,运行前使用命令cat /etc/passwd | grep squid查看是否有这组数据,没有的话,还得新建squid用户和组 cache_effective_group squid //设置缓存的有效用户组 dns_nameservers 8.8.8.8 cache_access_log /var/log/squid/access.log //设置访问日志文件 cache_log /var/log/squid/cache.log //设置缓存日志文件 cache_store_log /var/log/squid/store.log //设置网页存储日志 visible_hostname coolaj.cn cache_mgr aj@coolaj.cn //设置管理员邮箱 http_access allow all //授权 error_directory /usr/share/squid/errors/zh-cn //显示中文的错误信息

用这个就行了 sh-1.5.5

在服务器中执行:

wget http://www.coolaj.cn/vpn_centos6.sh

运行脚本

chmod a+x vpn_centos6.sh ./vpn_centos6.sh

执行后有1、2、3种英文,对应如下中文意思。

1. 安装VPN服务

2. 修复VPN

3. 添加VPN用户

如此,添加好VPN用户,在本地建立VPN链接,添加服务器的ip以及您设置的用户名面,就可以轻松使用VPN服务了

VPN速度慢的问题

执行下面命令:

/sbin/iptables -I FORWARD -p tcp --syn -i ppp+ -j TCPMSS --set-mss 1356

保存一下代码为502.sh

#!/bin/bash website=http://api.bbshenqi.com/User/ if curl -I $website|grep "HTTP/1.1 502" then /alidata/server/nginx/sbin/nginx -s reload /alidata/server/php/sbin/php-fpm reload fi

这样会在出现502错误的时候,重启nginx和php-fpm

获取权限

chmod +x 502.sh

添加到crontab定时任务(每八分钟执行一次)

crontab -e */5 * * * * /shell/502.sh